La injerencia de Anthropic en el sistema internacional

Por Estanislao Molinas

La inteligencia artificial está reconfigurando el sistema internacional al dar poder a actores tecnológicos no estatales. Empresas como Anthropic influyen indirectamente en la política global, al moldear capacidades y decisiones de otros actores.

El desarrollo exponencial de la inteligencia artificial (IA) está modificando el funcionamiento del sistema internacional (SI), históricamente centrado en los Estados, al incorporar actores transnacionales con capacidad de incidencia. En este contexto, empresas como Anthropic no solo producen tecnología avanzada, sino que también controlan el acceso a herramientas que afectan directamente la dinámica relacional y los márgenes de acción de distintos actores internacionales.

Este fenómeno plantea la necesidad de analizar su rol más allá del plano empresarial, considerando su capacidad de incidir en procesos propios del SI. A partir de este enfoque, el artículo examina el caso de Irán como instancia empírica para observar cómo estas compañías participan de manera indirecta en dinámicas internacionales, no mediante intervención directa, sino a través del desarrollo, disponibilidad y aplicación de capacidades tecnológicas que condicionan el comportamiento de otros actores.

A partir de esta sucinta introducción, se puede agregar que la problemática subyacente a ser abordada en este artículo radica en identificar si el desarrollo de IA contemporáneo está introduciendo nuevos actores con capacidad indirecta de alterar dinámicas previamente reservadas solo a los Estados.

En este sentido, la creciente complejidad del SI, profundizada por procesos de globalización, interdependencia y desarrollo tecnológico, ha favorecido la emergencia de actores transnacionales que, aun sin ostentar soberanía, poseen capacidades tecnológicas suficientes para influir en el comportamiento de otros actores.

Este desplazamiento no implica una sustitución del Estado, sino una ampliación del conjunto de actores relevantes dentro del sistema. Para abordar esta cuestión tan novedosa para la disciplina, resulta necesario definir qué se comprende por SI. Por ello, se puede recurrir a lo teorizado por Velázquez Flores, quién entiende por SI a aquel conjunto de actores, factores, procesos y patrones interactuantes en un espacio y un tiempo determinado (Velázquez Flores, 2011).

En segunda instancia, también es útil recuperar lo que se entiende por actores transnacionales dentro del SI. En esta línea, Elvira Sánchez Mateo (2021) comenta que estos actores tienen como característica esencial que su actividad trasciende las fronteras de los países para convertirse en actividad internacional.

Específicamente, dentro de este paraguas configurado por los actores transnacionales, las empresas multinacionales son aquel tipo de autoridad privada, diferente al Estado, que a veces son plausibles de ejercer poder significativo en el escenario internacional (Sánchez Mateo, 2021).

Una vez definidos tanto el SI como los actores transnacionales en el presente artículo, es pertinente describir qué son tanto OpenAI como Anthropic, así como su relevancia en la realidad internacional actual. Al respecto del primero, OpenAI se define a sí misma como una empresa de investigación y desarrollo de IA, con la misión de garantizar que la IA beneficie a toda la humanidad (OpenAI, s.f.). En cuanto a su estructura corporativa, OpenAI se compone de la Fundación OpenAI, una organización sin ánimo de lucro, y el Grupo OpenAI, un brazo empresarial con fines de lucro. La Fundación gobierna el Grupo, que opera como una corporación de beneficio público (OpenAI, s.f.).

En cuanto al segundo, Anthropic es una corporación de beneficio público cuyo propósito es el desarrollo y mantenimiento responsable de IA avanzada para el beneficio a largo plazo de la humanidad (Anthropic, s.f.). Su Consejo de Administración es elegido por los accionistas y actualmente está compuesto por Dario Amodei, Daniela Amodei, Yasmin Razavi, Jay Kreps, Reed Hastings y Chris Liddell (Anthropic, s.f.).

En términos de producto, OpenAI desarrolla y despliega sistemas de IA de propósito general que funcionan como interfaces capaces de asistir en una amplia variedad de tareas (OpenAI, s.f.). Su principal producto, ChatGPT, permite a los usuarios interactuar con grandes modelos de lenguaje avanzados mediante texto o voz, facilitando actividades como redacción, generación y depuración de código, análisis de información y aprendizaje asistido (OpenAI, s.f.).

Además, integran capacidades adicionales como búsqueda web en tiempo real, análisis de datos mediante archivos cargados, generación de imágenes, interacción con contenido visual y ejecución de tareas complejas a través de agentes que operan sobre internet (OpenAI, s.f.). Esta combinación de funciones posiciona a los productos de OpenAI no solo como aplicaciones aisladas, sino como un ecosistema de IA adaptable que permite potenciar procesos y aumentar la productividad en múltiples dominios (OpenAI, s. f.).

Pasando a la gama de ofertas de Anthropic, esta también desarrolla sistemas de IA centrados en la resolución de problemas a través de su familia de modelos Claude; diseñados para asistir en tareas como análisis, programación, generación de contenido y organización de información (Anthropic, s. f.). Claude funciona como un asistente-chatbot de IA que permite trabajar sobre problemas complejos de forma iterativa, estructurando datos y expandiendo el razonamiento del usuario en distintos contextos (Anthropic, s. f.).

Sobre esta base, la empresa desarrolla herramientas específicas como Claude Code, orientada a la generación, depuración y mantenimiento de software, y Claude Cowork, diseñada para delegar tareas operativas sobre archivos locales y aplicaciones, permitiendo ejecutar procesos completos como organización de datos o elaboración de reportes de manera autónoma (Anthropic, s. f.). Estas herramientas se integran en entornos de trabajo reales, combinando capacidades de análisis, automatización y ejecución, posicionando a Anthropic como una de las empresas transnacionales de IA más competitivas del mercado internacional junto a OpenAI.

Habiendo descrito entonces que se entiende por SI, cuál es la esencia de las empresas multinacionales como actor transnacional diverso al Estado-nación, y la naturaleza de OpenAI y Anthropic junto a sus productos desarrollados es factible interiorizarse en lo sucedido en Irán, ejemplo práctico y empírico para corroborar la incidencia que están teniendo las empresas abocadas al desarrollo de IA en los fenómenos internacionales.

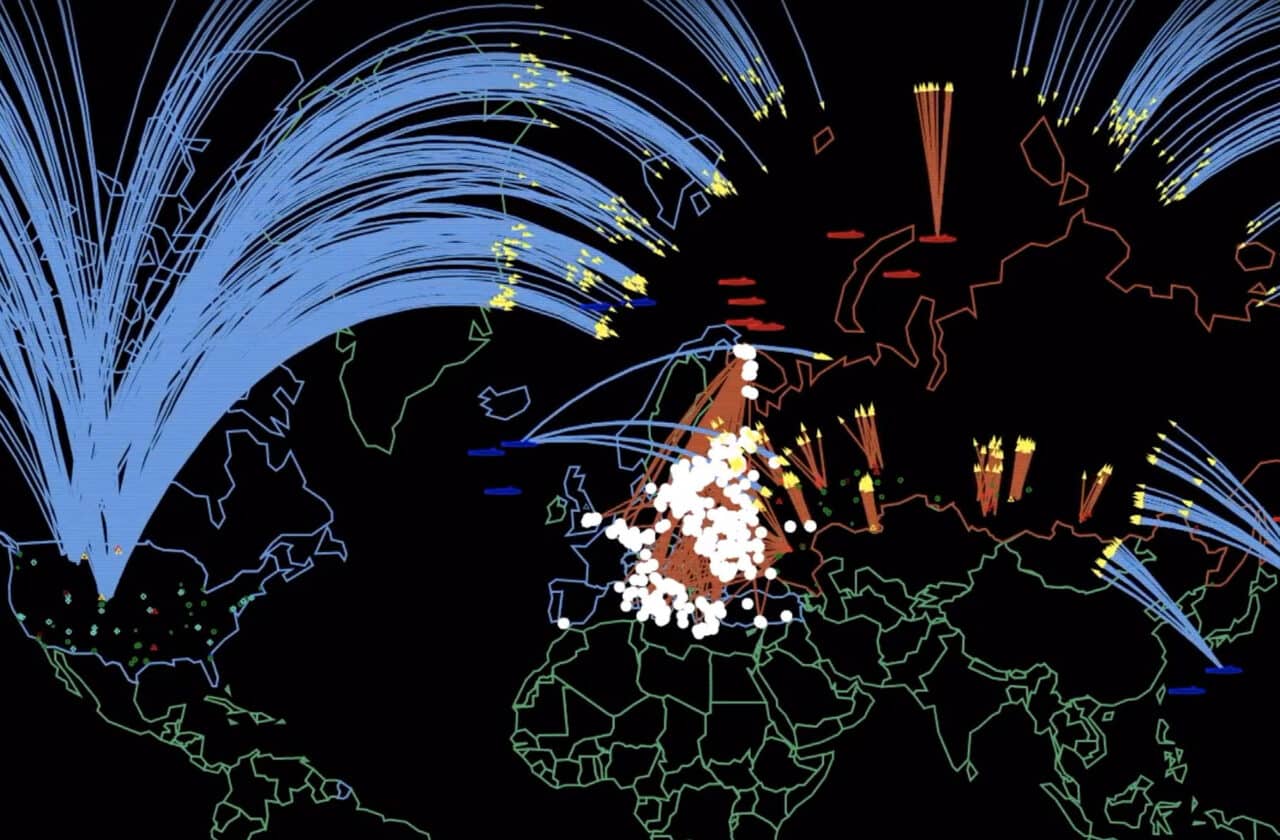

Atendiendo esta cuestión, y siguiendo lo trabajado por Schwartz, este conflicto en Oriente Medio se configura como un caso distintivo dentro de las guerras contemporáneas, no sólo por sus objetivos y dinámicas, sino por la incorporación sistemática de herramientas de IA en múltiples niveles de operación (Schwartz, 2026).

En este contexto, el uso de sistemas de IA por parte del aparato militar estadounidense les ha permitido procesar grandes volúmenes de información en tiempos reducidos, facilitando la toma de decisiones más rápidas que las del adversario. Estas capacidades introducen un cambio en la escala y velocidad de las operaciones, habilitando acciones simultáneas que anteriormente requerían días o semanas de planificación y ejecución (Schwartz, 2026).

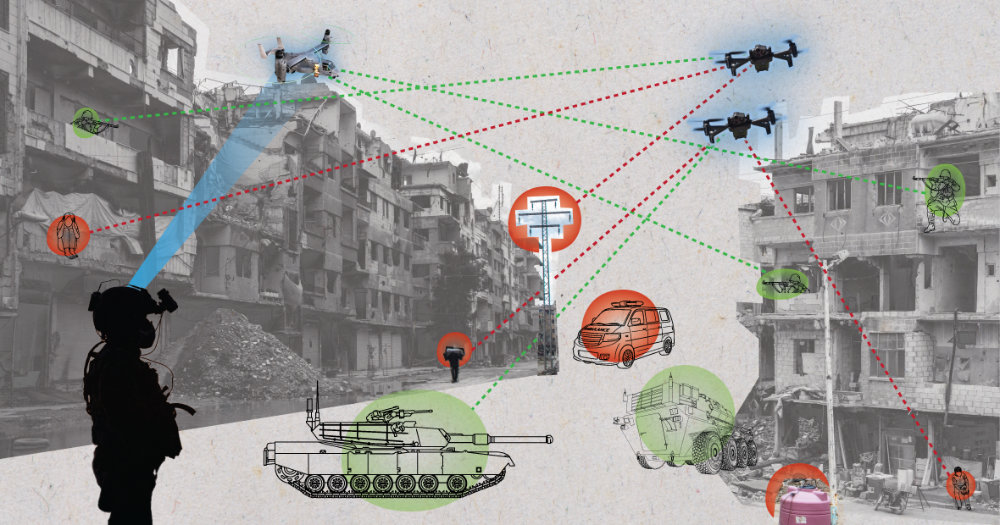

Dentro de este esquema, sistemas desarrollados por empresas como Palantir (la cuál desarrolla sistemas de IA autónomos para la ejecución remota de targets enemigos) permiten identificar y priorizar objetivos, recomendar recursos y evaluar escenarios operativos en función de datos previos y condiciones actuales.

A su vez, la integración de modelos de IA como Claude en estos sistemas marca su utilización en operaciones militares de mayor escala, consolidando su rol dentro de infraestructuras operativas estatales. Paralelamente, el uso de IA también se extiende al plano informacional, donde tanto Irán como sus adversarios emplean herramientas para generar, detectar y contrarrestar contenido manipulado en tiempo real.

Este despliegue simultáneo en dimensiones operativas e informacionales configura un entorno internacional de conflicto en el que la IA, o mejor dicho las empresas multinacionales que la desarrollan, no solo aceleran procesos existentes, sino que inciden la en cómo se desarrollan las operaciones militares en el Q1 de 2026 (Schwartz, 2026).

En esta línea, el modelo Claude, desarrollado por Anthropic, está siendo utilizado activamente por el Departamento de Defensa de Estados Unidos en el marco de las operaciones vinculadas al conflicto con Irán, específicamente en tareas de análisis de inteligencia dentro de operaciones en curso. Este uso fue confirmado en instancias institucionales, lo que demuestra que una herramienta desarrollada por una empresa privada se encuentra integrada directamente en los procesos mediante los cuales el aparato militar recopila, procesa y transforma información en decisiones operativas (Timotija, 2026).

En otras palabras, no se trata de un uso periférico, sino de una inserción en el núcleo funcional de la capacidad estatal en contexto de conflicto. Sin embargo, esta integración no implica una alineación plena entre el Estado y la empresa, por el contrario, la relación se encuentra atravesada por tensiones concretas (Timotija, 2026).

El propio Departamento de Defensa clasificó a los sistemas de Anthropic como un riesgo inaceptable dentro de la cadena de suministro y estableció un plazo de 180 días para su eliminación de las redes militares, permitiendo únicamente excepciones temporales para no afectar las operaciones en curso.

Esto introduce una contradicción clara: la misma tecnología -la IA- que es considerada riesgosa, continúa siendo utilizada porque resulta funcionalmente necesaria en el corto plazo. Esta situación derivó además en un conflicto abierto entre Anthropic y el gobierno estadounidense, incluyendo acciones legales por parte de la empresa, que calificó la medida como sin precedentes e ilegal (Timotija, 2026). En este contexto, la relación entre empresas de IA y estructuras estatales no puede explicarse como una relación jerárquica tradicional, sino como una dinámica simultánea de cooperación y conflicto.

A partir de lo expuesto, el caso analizado permite sostener que la incorporación de sistemas de IA en contextos de conflicto no solo modifica las capacidades operativas de los Estados, sino que introduce una alteración más profunda en la estructura del SI.

En particular, evidencia que empresas como Anthropic ya no operan exclusivamente como proveedoras externas de servicios tecnológicos, sino que inciden directamente en la capacidad estatal de procesar información, tomar decisiones y ejecutar acciones en tiempo real. Esta situación genera una relación de dependencia funcional que limita el margen de autonomía del Estado en el corto plazo, incluso cuando este intenta regular o restringir dichas tecnologías.

En consecuencia, se configura un escenario en el que el poder no se concentra únicamente en actores estato-céntricos soberanos, sino que se distribuye parcialmente hacia actores transnacionales con control sobre capacidades tecnológicas de punta.

Esto no implica una sustitución del Estado, pero sí una reconfiguración de sus condiciones de acción, donde la cooperación con empresas tecnológicas se vuelve necesaria, al mismo tiempo que su control se vuelve problemático.

En este marco, el caso iraní funciona como evidencia empírica de un proceso más amplio: la emergencia de empresas de IA como actores con capacidad indirecta pero efectiva de incidir en las dinámicas del SI contemporáneo.

Estanislao Molinas (Argentina): Estudiante avanzado en Relaciones Internacionales, Universidad Católica de Santa Fe, y columnista en Diplomacia Activa.

Categorías